按Enter到主內容區

紀錄片《編碼偏見Coded Bias》描繪人工智慧技術(AI)在沒有被監控、驗證下,如何侵害世界、人權,在演算法的背後又隱藏了多少腐敗、不堪,PTT 創世神、台灣人工智慧實驗室(Taiwan AI Labs)創辦人杜奕瑾說,不負責任的 AI 不是我們「將」要注意的事,而是已經硬加在生活當中。有人說,中國人工智慧的發展將會「超英趕美」,因為極權國家不用顧及人權、隱私,可以獲取大量資訊,但他始終堅信:「人工智慧的決勝點,不是在資料多寡,而在於演算法能否被信任。」

台灣人工智慧實驗室(Taiwan AI Labs)創辦人杜奕瑾。(圖/台灣人工智慧實驗室提供)

台灣人工智慧實驗室(Taiwan AI Labs)創辦人杜奕瑾。(圖/台灣人工智慧實驗室提供)

重視人權、隱私的歐盟在 2020 年發布人工智慧白皮書,明確指出歐盟將建立「AI 信任生態圈(Ecosystem of Trust)」,透過強化 AI 安全與責任法規的安定性,建立以風險為基礎的 AI 監管方式,確保 AI 技術的發展能夠充分遵守歐盟規範,也將成為往後世界各國 AI 立法的標竿。

杜奕瑾說,全世界對於「負責任的 AI」都有許多討論,他在 2017 年成立台灣人工智慧實驗室,某種程度也是在回應全世界,台灣身為民主國家,在開發人工智慧上會尊重民主制度,在演算法上更會依循公開、可透明、可檢視、可驗證等原則,同時在資料治理上,會遵行歐盟「一般資料保護規範(GDPR)」,也就是個人的資料屬於個人的、每個人都有被遺忘權。

民主國家的科技防疫 兼顧隱私與人權

新冠肺炎去年開始衝擊人類生活,各國都在發展科技防疫,杜奕瑾指出,極權國家總是認為他們的科技防疫可以做到最好,因為可以用極權、違反人權的手段取得資料,做出最好的 AI,但在台灣,我們仍可以在保障人權、隱私的前提下,做到去中心化的分析。

舉例而言,去年 4 月開發完成的社交距離 APP,不必追蹤使用者的足跡,而是利用藍牙訊號強弱計算使用者之間的距離,後來 Apple、Google 共同開發的「暴露通知系統(Exposure Notifications System, ENS)」,其中的技術和想法正是來自社交距離 App。

針對曾到疫情熱區的人們發送細胞簡訊也是一樣的概念,政府不需要知道每人的行蹤,只要知道哪邊是高危險區,請電信公司針對曾到過該區的人發送通知即可。

在醫療層面,台灣醫學影像公司與醫療機構合作開發的「AI 胸部 X 光片輔助偵測系統」,可輔助偵測新冠肺炎患者的胸部 X 光片,若發現疑似染疫並且提早示警,就可以守住醫院防線,日前被衛福部食藥署最新專案核准,並已在多家醫院使用。

.png?alt=media&token=d8f4bda6-2d3d-42f5-9246-9501abea5b60) AI 胸部 X 光片輔助偵測系統圖示。(圖/台灣人工智慧實驗室提供)

AI 胸部 X 光片輔助偵測系統圖示。(圖/台灣人工智慧實驗室提供)

杜奕瑾說,在嚴格的個資法保護下,他們靠「聯合學習」(Federated Learning,亦稱聯邦學習)來訓練模型,醫院就不必共享高機敏性資料,所有的資料都仍儲存在醫院端。這些都是台灣兼顧隱私、人權的科技防疫案例。

不只微信、微博,臉書、推特也助長假消息傳播

此外,在新冠肺炎疫情期間,有非常多假訊息到處流竄,而台灣正因是亞洲言論自由度最高的國家,就成了假消息的培養皿。

杜奕瑾說,過去認為傳遞假訊息的平台多為中國的社交平台如微信、微博,但其實不只是如此,臉書、推特也都助長了假消息的傳遞。我們知道臉書宣稱會下架假消息,但是被下架的一定都是仇恨言論跟假消息嗎?

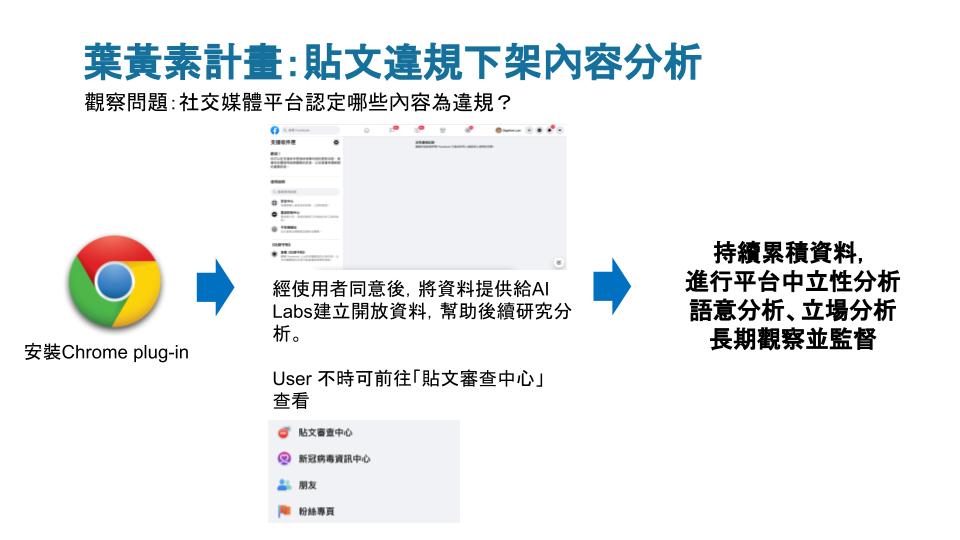

台灣人工智慧實驗室日前發起「葉黃素計畫」,針對被臉書下架的言論進行分析,結果發現,多數被下架的文章其實跟假消息、仇恨言論沒有關係,而是跟高度政治敏感的話題有關,譬如涉及到台灣、香港、中國、印度的言論,但進一步分析內容,多半是可受公評之事,98% 的言論都被臉書過度審查。

杜奕瑾說,社交媒體跟假消息是共生關係,說好聽是要事實查核、打擊假消息和仇恨言論,但其實是增加自己的權利做不對稱的言論審查,反而壓縮了可受公評事件的聲音。

「我們相信 AI 會演變成 Super Power,因此在發展 AI 的同時,必須同時就要注意不能單單只為追求利益。」杜奕瑾說,未來所有的應用都可能仰賴人工智慧,但若是被單一組織把持,可能是中國政府,或美國 Facebook、Google、Apple 等大型科技產業,當人類在享受 AI 帶來便利性的時候,我們同時也成了 AI 的棋子,若持續放任科技公司,可用利潤為導向發展 AI 演算法,就會發生嚴重的後果。

「葉黃素計畫」流程說明圖。(圖/台灣人工智慧實驗室提供)

「葉黃素計畫」流程說明圖。(圖/台灣人工智慧實驗室提供)

透過產業大聯盟建立遊戲規則,讓 AI 成為負責任的 AI

既然如此,AI 到底該不該被人類監管?杜奕瑾說,他不喜歡用「監管」這一詞形容,他們建立了 AI 產業大聯盟,不是要讓政府建立制度「監管」AI,而是希望一起訂定遊戲規則,包含透明度、中立度、可效性的分析。舉例來說,特斯拉宣稱在美國可以做到全自動駕駛,在台灣就真的可以套用嗎?在醫療健康的領域,未來各項應用可能都是 AI 決定,要怎麼驗證確效、確定是負責任的演算法?

杜奕瑾進一步說明,在合理的架構下,結合大家的能力,就可以變成一個商業模型,合理的回饋給當初有貢獻的人,也不會因為資料被單一組織把持,造成數位極權的現象。

但要做到負責任的 AI 也不全然靠產業自律,杜奕瑾認為,政府也一定要升級。目前政府的組織架構已經過時,需要數位轉型,更需要全面盤點在新的數位經濟時代,如何避免被科技公司壟斷,如何防止不負責任的 AI 迫害到言論自由或人們的財產、健康權,以及如何建構新的經濟模式。

杜奕瑾強調,最重要的還是要鼓勵優良的 AI 存續,劣質的被淘汰,更應該滾動式修正不合時宜的法規,才能真正構築一個擁有負責任 AI 的世界。